कभी आपने सोचा है कि आपके द्वारा सोशल मीडिया साइट पर अपलोड की गई सेल्फी का क्या होता है? कार्यकर्ताओं और शोधकर्ताओं ने डेटा गोपनीयता के बारे में लंबे समय तक चेतावनी दी है और कहा है कि इंटरनेट पर अपलोड की गई तस्वीरों का उपयोग कृत्रिम बुद्धिमत्ता (एआई) संचालित डिजिटल मान्यता उपकरण को प्रशिक्षित करने के लिए किया जा सकता है। ये एआई-सक्षम उपकरण (जैसे क्लियरव्यू, एडब्ल्यूएस रिकॉग्निशन, माइक्रोसॉफ्ट एज़्योर, और फेस ++) का उपयोग सरकार या अन्य संस्थानों द्वारा लोगों को ट्रैक करने और यहां तक कि विषय की धार्मिक या राजनीतिक प्राथमिकताओं जैसे निष्कर्ष निकालने के लिए किया जा सकता है। शोधकर्ताओं ने इन AI टूल को प्रतिकूल तरीकों से पहचानने या यहां तक कि एक सेल्फी का पता लगाने, या इनपुट डेटा को बदलने का एक तरीका, जो गलतियों को बनाने के लिए एक गहरी-सीखने वाले मॉडल का कारण बनता है, को पहचानने में सक्षम बनाने के लिए आया है।

इनमें से दो तरीके पिछले सप्ताह प्रस्तुत किए गए थे सीखने के प्रतिनिधियों का अंतर्राष्ट्रीय सम्मेलन (ICLR)एक प्रमुख AI सम्मेलन जो वस्तुतः आयोजित किया गया था। एक के अनुसार रिपोर्ट good MIT प्रौद्योगिकी की समीक्षा के द्वारा, चेहरे की पहचान करने वाले सॉफ़्टवेयर को धोखा देने के लिए इन नए उपकरणों में से अधिकांश एक ऐसी छवि में छोटे बदलाव करते हैं जो मानव आंखों को दिखाई नहीं देती हैं, लेकिन एक AI को भ्रमित कर सकती हैं, जिससे सॉफ्टवेयर व्यक्ति या वस्तु की स्पष्ट रूप से पहचान करने में गलती करने के लिए मजबूर हो जाता है। छवि में, या, यहां तक कि छवि को साकार करने से रोकना एक सेल्फी है।

शिकागो विश्वविद्यालय से एमिली वेंगर ने अपने सहयोगियों के साथ फॉक्स नामक इन ‘इमेज क्लोकिंग’ उपकरणों में से एक विकसित किया है। अन्य, जिसे लोके कहा जाता है, का विकास वेलेरिया चेरेपानोवा और उनके सहयोगियों ने मैरीलैंड विश्वविद्यालय में किया है।

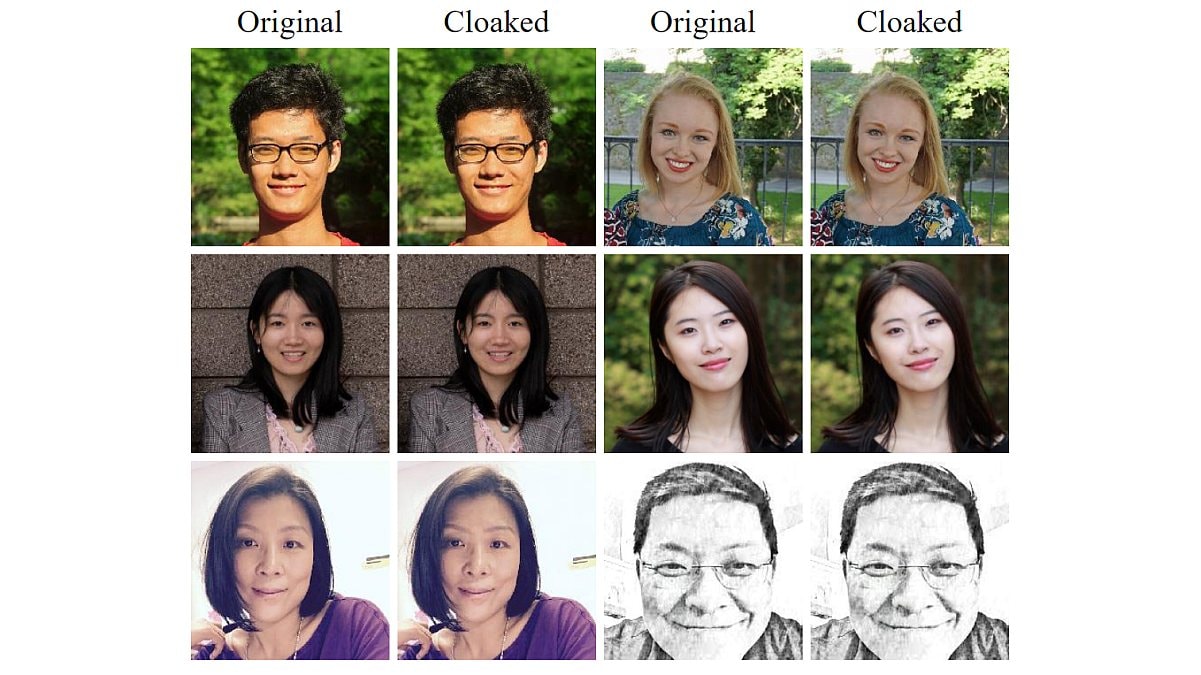

फॉक्स उन छवियों को पिक्सेल-स्तर की गड़बड़ी जोड़ता है जो चेहरे की पहचान प्रणालियों को उन व्यक्तियों की पहचान करने से रोकते हैं लेकिन यह छवि को मनुष्यों के लिए अपरिवर्तित छोड़ देता है। 50 छवियों के एक छोटे डेटा सेट के साथ एक प्रयोग में, फॉक्स को वाणिज्यिक चेहरे की पहचान प्रणालियों के खिलाफ 100 प्रतिशत प्रभावी पाया गया। फॉक्स हो सकता है डाउनलोड की गई विंडोज और मैक के लिए, और इसकी विधि एक पेपर में विस्तृत थी शीर्षक ‘अनधिकृत डीप लर्निंग मॉडल के खिलाफ व्यक्तिगत गोपनीयता की रक्षा करना’।

हालाँकि, लेखक ध्यान दें कि Fawkes मौजूदा सिस्टम को गुमराह नहीं कर सकते हैं जो पहले से ही आपके असुरक्षित चित्रों पर प्रशिक्षित हैं। लोकेय, जो कि वेंगर की प्रणाली को विस्तार से छवियों को एक हद तक बदलकर विस्तारित करता है, ताकि वे कमर्शियल एआई मॉडल को मूर्ख बना सकें, जिससे व्यक्ति को छवि में पहचानने से रोका जा सके। लोके, एक में विस्तृत कागज़ ‘लेवरेजिंग एडवरसरी अटैक्स टू प्रोटेक्ट सोशल मीडिया यूजर्स फ्रॉम फेशियल रिकॉग्निशन’ उपलब्ध ऑनलाइन उपयोग के लिए।

फिर भी एक अन्य विधि, विस्तृत ऑस्ट्रेलिया के डीकिन विश्वविद्यालय के डैनियल मा और अन्य शोधकर्ताओं द्वारा ‘अनलॉजेबल एग्जाम: मेकिंग पर्सनल डेटा अनसेफ्लोएबल’ शीर्षक वाले पेपर में इस तरह के ‘डेटा पॉइजनिंग’ को एक कदम और आगे बढ़ाया गया है, जो एक एआई मॉडल को प्रशिक्षण के दौरान इसे छोड़ने के लिए मजबूर करने वाली छवियों में बदलाव पेश करता है। , मूल्यांकन के बाद प्रशिक्षण को रोकना।

वेंजर ने नोट किया कि फॉक्स ने संक्षेप में Microsoft Azure को धोखा देने में असमर्थ था, कहा, “यह अचानक किसी भी तरह से क्लोज्ड छवियों के लिए मजबूत हो गया जो हमने उत्पन्न किया था … हमें नहीं पता कि क्या हुआ।” उसने कहा कि यह अब एआई के खिलाफ एक दौड़ थी, फॉक्स के साथ बाद में फिर से एज़्योर को बिगाड़ने में सक्षम होने के लिए अपडेट किया गया। “यह एक और बिल्ली और चूहे की दौड़ है,” उसने कहा।

रिपोर्ट में वेंगर के हवाले से यह भी कहा गया है कि इस तरह के एआई टूल्स के खिलाफ नियमन गोपनीयता बनाए रखने में मदद करेगा, कानूनी रूप से स्वीकार्य और लोग क्या चाहते हैं, के बीच हमेशा एक “डिस्कनेक्ट” होगा, और फॉक्स की तरह स्पूफिंग तरीके “अंतर” भरने में मदद कर सकते हैं। वह कहती हैं कि इस उपकरण को विकसित करने की उनकी प्रेरणा सरल थी: लोगों को “कुछ शक्ति” देने के लिए जो उनके पास पहले से नहीं थी।

।